Google Cloud Onthult Revolutionaire AI-Infrastructuur: Ironwood TPU en de Gigantische Deal met Anthropic

In een tijdperk waarin kunstmatige intelligentie de digitale wereld transformeert, staat de infrastructuur die deze innovaties aandrijft centraal. Recentelijk heeft Google Cloud een baanbrekende aankondiging gedaan die de lat voor AI-capaciteit aanzienlijk verhoogt. Het bedrijf onthulde zijn krachtigste AI-infrastructuur tot nu toe, gekenmerkt door een zevende-generatie Tensor Processing Unit (TPU) en uitgebreide Arm-gebaseerde computing-opties. Deze ontwikkelingen zijn specifiek ontworpen om te voldoen aan de explosieve vraag naar de implementatie van AI-modellen – een fundamentele verschuiving van het trainen van modellen naar het beschikbaar stellen ervan aan miljarden gebruikers. Kortom, Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions, een zet die de industrie ongetwijfeld zal beïnvloeden.

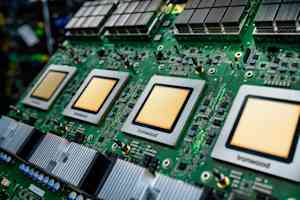

De kern van deze aankondiging, die donderdag werd gedaan, is de introductie van Ironwood, Google's nieuwste op maat gemaakte AI-acceleratorchip, die de komende weken algemeen beschikbaar zal zijn. Als een opvallende bevestiging van deze technologie heeft Anthropic, het AI-veiligheidsbedrijf achter de Claude-modellenfamilie, plannen bekendgemaakt om toegang te krijgen tot maar liefst één miljoen van deze TPU-chips. Deze verbintenis, ter waarde van tientallen miljarden dollars, behoort tot de grootste bekende AI-infrastructuurdeals tot op heden en onderstreept de immense waarde die de markt hecht aan deze nieuwe capaciteiten. Met deze strategische zet laat Google zien dat het klaar is voor de toekomst van AI.

Google Cloud Onthult Revolutionaire AI-Infrastructuur met Ironwood TPU

De introductie van Ironwood markeert een significant moment voor Google Cloud en de bredere AI-industrie. Deze zevende-generatie Tensor Processing Unit (TPU) is niet zomaar een upgrade; het vertegenwoordigt een kwantumsprong in de capaciteit om complexe AI-workloads te verwerken. De focus verschuift steeds meer van louter het trainen van AI-modellen, wat in het verleden veel aandacht en middelen vroeg, naar het effectief en efficiënt aanbieden van deze modellen aan eindgebruikers op grote schaal. Google's investering in Ironwood, als onderdeel van zijn AI Hypercomputer-strategie, is een directe reactie op deze verschuiving, met de belofte van ongekende prestaties voor AI-modelimplementatie. Deze revolutionaire ontwikkeling toont aan dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions, wat de concurrentie in de cloudsector verder aanwakkert. De aankondiging zet Google stevig neer als een belangrijke speler in de ontwikkeling van gespecialiseerde AI-hardware.

De zet van Google onderstreept een toenemende concurrentie tussen cloudproviders om de infrastructuurlaag die kunstmatige intelligentie aandrijft te beheersen, zelfs nu er vragen rijzen over de duurzaamheid van het huidige tempo van kapitaaluitgaven in de sector. De aanpak van Google – het bouwen van op maat gemaakte silicium in plaats van uitsluitend te vertrouwen op Nvidia's dominante GPU-chips – komt neer op een langetermijninvestering. Dit is een gok dat verticale integratie, van chipontwerp tot software, superieure economie en prestaties zal opleveren. De capaciteit die Ironwood biedt, is een direct antwoord op de escalerende eisen van de 'age of inference', waarbij bedrijven hun resources verschuiven van het trainen van geavanceerde AI-modellen naar het inzetten ervan in productie-applicaties die dagelijks miljoenen of miljarden verzoeken verwerken.

Waarom de "Age of Inference" Cruciaal is voor Bedrijven

Google-directeuren hebben de aankondigingen gekaderd rondom wat zij de "age of inference" noemen – een overgangspunt waar bedrijven middelen verschuiven van het trainen van frontier AI-modellen naar het inzetten ervan in productie-applicaties die dagelijks miljoenen of miljarden verzoeken verwerken. "De huidige geavanceerde modellen, waaronder Google's Gemini, Veo en Imagen, en Anthropic's Claude, trainen en serveren allemaal op Tensor Processing Units," aldus Amin Vahdat, vicepresident en algemeen directeur AI en Infrastructuur bij Google Cloud. "Voor veel organisaties verschuift de focus van het trainen van deze modellen naar het aandrijven van nuttige, responsieve interacties ermee." Deze overgang heeft diepgaande implicaties voor infrastructuurvereisten. Waar trainingsworkloads vaak batchverwerking en langere voltooiingstijden kunnen verdragen, vereist inferentie – het proces van het daadwerkelijk uitvoeren van een getraind model om reacties te genereren – consistent lage latentie, hoge doorvoer en onwrikbare betrouwbaarheid. Een chatbot die 30 seconden nodig heeft om te reageren, of een codeerassistent die vaak time-outs heeft, wordt onbruikbaar, ongeacht de mogelijkheden van het onderliggende model. Agentic workflows, waarbij AI-systemen autonome acties ondernemen in plaats van simpelweg te reageren op prompts, creëren bijzonder complexe infrastructuuruitdagingen, die een nauwe coördinatie vereisen tussen gespecialiseerde AI-versnellers en algemene computing.

Ironwood: Een Blik op de Architectuur en Prestaties die de Lat Hoger Leggen

Ironwood is veel meer dan een incrementele verbetering ten opzichte van Google's zesde-generatie TPU's. Volgens technische specificaties van het bedrijf levert het meer dan vier keer betere prestaties voor zowel training- als inferentieworkloads vergeleken met zijn voorganger – winsten die Google toeschrijft aan een systeembreed co-design aanpak in plaats van simpelweg het verhogen van transistorcounts. Deze prestatieverbetering, samen met de schaal van de inzet, maakt deel uit van de reden waarom Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions, de aandacht trekt van de hele tech-wereld. Deze indrukwekkende sprong voorwaarts onderstreept Google's toewijding aan het leiden van de ontwikkeling van krachtige AI-hardware.

De meest opvallende eigenschap van de architectuur is de schaal. Een enkele Ironwood "pod" – een strak geïntegreerde eenheid van TPU-chips die functioneert als één supercomputer – kan tot wel 9.216 individuele chips verbinden via Google's eigen Inter-Chip Interconnect-netwerk, dat opereert met 9,6 terabit per seconde. Om die bandbreedte in perspectief te plaatsen: dat is ruwweg gelijk aan het downloaden van de complete Library of Congress in minder dan twee seconden. Dit enorme interconnect-fabric stelt de 9.216 chips in staat om toegang te delen tot 1,77 petabyte High Bandwidth Memory (HBM) – geheugen dat snel genoeg is om gelijke tred te houden met de verwerkingssnelheden van de chips. Dat is ongeveer 40.000 high-definition Blu-ray films aan werkgeheugen, direct toegankelijk door duizenden processors tegelijkertijd.

Het Ongekende Vermogen van Ironwood's Systeemontwerp

De systeemarchitectuur van Ironwood omvat Optical Circuit Switching (OCS) technologie die fungeert als een "dynamisch, herconfigureerbaar fabric". Wanneer individuele componenten falen of onderhoud vereisen – onvermijdelijk op deze schaal – leidt de OCS-technologie het dataverkeer automatisch binnen milliseconden om de onderbreking heen, waardoor workloads kunnen blijven draaien zonder zichtbare verstoring voor de gebruiker. Deze focus op betrouwbaarheid reflecteert lessen die zijn geleerd uit de implementatie van vijf eerdere TPU-generaties. Google meldde dat de uptime van zijn vlootbrede vloeistofgekoelde systemen sinds 2020 ongeveer 99,999% beschikbaarheid heeft gehandhaafd – gelijk aan minder dan zes minuten downtime per jaar. Dit niveau van systeemstabiliteit is cruciaal voor de veeleisende AI-workloads van vandaag.

Anthropic's Strategische Alliantie en de Impact van de Megadeal

De misschien wel meest significante externe bevestiging van de capaciteiten van Ironwood komt van Anthropic's verbintenis om toegang te krijgen tot maar liefst één miljoen TPU-chips – een duizelingwekkend aantal in een industrie waar zelfs clusters van 10.000 tot 50.000 accelerators als massief worden beschouwd. "Anthropic en Google hebben een langdurig partnerschap en deze nieuwste uitbreiding zal ons helpen de computing die we nodig hebben om de grens van AI te definiëren, verder te laten groeien," aldus Krishna Rao, Chief Financial Officer van Anthropic, in de officiële partnerovereenkomst. Deze deal is een directe illustratie van waarom Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions, zo veel aandacht krijgt. De omvang van de deal benadrukt de enorme investeringen die nodig zijn om de volgende generatie AI-modellen te bouwen en in te zetten.

Volgens een afzonderlijke verklaring zal Anthropic toegang hebben tot "ruim een gigawatt aan capaciteit die in 2026 online komt" – genoeg elektriciteit om een kleine stad van stroom te voorzien. Het bedrijf noemde specifiek de "prijs-prestatie en efficiëntie" van TPU's als sleutelfactoren in de beslissing, samen met "bestaande ervaring in het trainen en serveren van zijn modellen met TPU's." Industrieanalisten schatten dat een verbintenis om toegang te krijgen tot één miljoen TPU-chips, met bijbehorende infrastructuur, netwerken, stroom en koeling, waarschijnlijk een meerjarig contract vertegenwoordigt ter waarde van tientallen miljarden dollars – tot de grootste bekende cloudinfrastructuurverbintenissen in de geschiedenis. James Bradbury, hoofd compute bij Anthropic, lichtte de focus op inferentie verder toe: "Ironwood's verbeteringen in zowel inferentieprestaties als trainingsschaalbaarheid zullen ons helpen efficiënt te schalen, terwijl we de snelheid en betrouwbaarheid behouden die onze klanten verwachten."

Waarom Anthropic Inzet op Google's TPU's

De keuze van Anthropic voor Google's TPU's is een duidelijke validatie van Google's strategie van verticaal geïntegreerd siliciumontwerp. Het feit dat een leidend AI-veiligheidsbedrijf zo'n enorme verbintenis aangaat, spreekt boekdelen over het vertrouwen in de capaciteiten van Ironwood, vooral met betrekking tot inferentie. Voor AI-modellen zoals Claude, die dagelijks miljoenen gebruikersinteracties verwerken, zijn lage latentie en hoge doorvoer van vitaal belang. De superieure prijs-prestatieverhouding en de bewezen efficiëntie van TPU's, gecombineerd met Anthropic's reeds bestaande ervaring met deze chips, maakten de beslissing duidelijk. Dit partnerschap is een krachtig signaal voor de industrie, en toont de impact van de recente aankondiging: Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions, en verstevigt daarmee zijn positie in de competitieve AI-markt. De strategische samenwerking zorgt ervoor dat Anthropic kan blijven innoveren en voldoen aan de exponentieel groeiende vraag naar zijn AI-modellen.

Google's Axion Processoren: De Fundamenten voor AI-Applicaties

Naast Ironwood introduceerde Google uitgebreide opties voor zijn Axion-processorfamilie – op maat gemaakte Arm-gebaseerde CPU's die zijn ontworpen voor algemene workloads die AI-applicaties ondersteunen, maar geen gespecialiseerde accelerators vereisen. Het N4A-instancetype, dat nu in preview is, richt zich op wat Google beschrijft als "microservices, gecontaineriseerde applicaties, open-source databases, batchverwerking, data-analyse, ontwikkelomgevingen, experimentatie, datapreparatie en webserverjobs die AI-applicaties mogelijk maken." Het bedrijf beweert dat N4A tot 2X betere prijs-prestaties levert dan vergelijkbare huidige-generatie x86-gebaseerde virtuele machines. Dit complementaire aanbod is een cruciaal onderdeel van Google's bredere strategie, die erkent dat naast de pure rekenkracht van AI-chips, ook efficiënte algemene verwerkingseenheden nodig zijn. De introductie van Axion, naast Ironwood, benadrukt de volledige infrastructuurvisie achter de bewering dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions.

Google biedt ook een preview van C4A metal, zijn eerste bare-metal Arm-instantie, die dedicated fysieke servers biedt voor gespecialiseerde workloads zoals Android-ontwikkeling, autosystemen en software met strikte licentievereisten. De Axion-strategie weerspiegelt een groeiende overtuiging dat de toekomst van computerinfrastructuur zowel gespecialiseerde AI-accelerators als zeer efficiënte algemene processoren vereist. Terwijl een TPU de computationeel intensieve taak van het draaien van een AI-model afhandelt, beheren Axion-klasse processoren data-invoer, preprocessing, applicatielogica, API-serving en talloze andere taken in een moderne AI-applicatiestack.

Axion en de Complementaire Rol in het AI-Ecosysteem

Vroege klantresultaten suggereren dat de aanpak meetbare economische voordelen oplevert. Vimeo rapporteerde een "30% verbetering in prestaties voor onze core transcoding workload vergeleken met vergelijkbare x86 VM's" in initiële N4A-tests. ZoomInfo mat "een 60% verbetering in prijs-prestaties" voor dataverwerkingspipelines die draaien op Java-services, volgens Sergei Koren, Chief Infrastructure Architect van het bedrijf. Deze resultaten tonen aan dat de Axion-processoren een belangrijke rol spelen in het optimaliseren van de totale kosten en efficiëntie van AI-applicaties. Door zowel gespecialiseerde als algemene rekenkracht te optimaliseren, creëert Google een robuust ecosysteem dat klaar is voor de diverse eisen van de moderne AI-ontwikkeling. De combinatie van Ironwood en Axion, ondersteund door een gigantische deal, maakt duidelijk dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions niet alleen over chips gaat, maar over een complete, geïntegreerde oplossing.

Software: De Sleutel tot het Onsluiten van Hardwarepotentieel

Hardwareprestaties betekenen weinig als ontwikkelaars deze niet gemakkelijk kunnen benutten. Google benadrukte dat Ironwood en Axion zijn geïntegreerd in wat het de AI Hypercomputer noemt – "een geïntegreerd supercomputing-systeem dat computing, netwerken, opslag en software samenbrengt om de systeemprestaties en efficiëntie te verbeteren." Volgens een IDC Business Value Snapshot-studie van oktober 2025 behaalden AI Hypercomputer-klanten gemiddeld 353% driejarige return on investment, 28% lagere IT-kosten en 55% efficiëntere IT-teams. Deze cijfers onderstrepen de waarde van een holistische benadering, waarbij software-optimalisatie hand in hand gaat met revolutionaire hardware. Het is de synergie tussen deze componenten die de ware kracht ontsluit, waardoor de uitspraak dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions nog meer gewicht krijgt.

Google maakte verschillende softwareverbeteringen bekend die zijn ontworpen om Ironwood optimaal te benutten. Google Kubernetes Engine (GKE) biedt nu geavanceerd onderhoud en topologiebewustzijn voor TPU-clusters, wat intelligente scheduling en zeer veerkrachtige deployments mogelijk maakt. Het open-source MaxText-framework van het bedrijf ondersteunt nu geavanceerde trainingstechnieken, waaronder Supervised Fine-Tuning en Generative Reinforcement Policy Optimization. Misschien wel het meest significant voor productiedistributies is Google's Inference Gateway, die intelligent load-balancing uitvoert over modelservers om kritieke metrics te optimaliseren. Volgens Google kan het de 'time-to-first-token'-latentie met 96% verminderen en de servingkosten met tot wel 30% door technieken zoals prefix-cache-aware routing.

Optimalisatie en Efficiëntie met Inference Gateway

De Inference Gateway monitort belangrijke metrics, waaronder KV cache hits, GPU- of TPU-utilisatie en de lengte van de aanvraagwachtrij, en routeert vervolgens binnenkomende aanvragen naar de optimale replica. Voor conversationele AI-applicaties, waarbij meerdere aanvragen context kunnen delen, kan het routeren van aanvragen met gedeelde prefixes naar dezelfde serverinstantie de redundante computation drastisch verminderen. Dit verhoogt niet alleen de efficiëntie, maar zorgt ook voor een vloeiendere en snellere gebruikerservaring, wat essentieel is in de "age of inference." Deze intelligente softwarelagen zijn even cruciaal als de fysieke chips zelf, en demonstreren Google's diepgaande begrip van het complete AI-ecosysteem. Het is deze integratie van hardware en slimme software die de krachtige prestaties levert die leiden tot de conclusie dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions, wat een gamechanger is voor de industrie.

De Onzichtbare Uitdaging: Stroomvoorziening en Koeling op Megawatt-Schaal

Achter deze aankondigingen schuilt een enorme fysieke infrastructuuruitdaging die Google heeft aangepakt op de recente Open Compute Project EMEA Summit. Het bedrijf maakte bekend dat het +/-400 volt gelijkstroomvoeding implementeert die in staat is om tot één megawatt per rack te ondersteunen – een tienvoudige toename ten opzichte van typische deployments. "Het AI-tijdperk vereist nog grotere stroomvoorzieningsmogelijkheden," legden Madhusudan Iyengar en Amber Huffman, Google principal engineers, uit in een blogpost van april 2025. "ML zal vóór 2030 meer dan 500 kW per IT-rack vereisen." Google werkt samen met Meta en Microsoft om elektrische en mechanische interfaces voor hoogspannings-DC-distributie te standaardiseren. Het bedrijf koos specifiek voor 400 VDC om de toeleveringsketen van elektrische voertuigen te benutten, "voor grotere schaalvoordelen, efficiëntere productie en verbeterde kwaliteit en schaal." Dit toont de diepte van de planning achter het feit dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions, verder gaat dan alleen silicium.

Wat koeling betreft, onthulde Google dat het zijn vijfde-generatie koeldistributie-unit (CDU) ontwerp zal bijdragen aan het Open Compute Project. Het bedrijf heeft vloeistofkoeling "op GigaWatt-schaal ingezet in meer dan 2.000 TPU-pods in de afgelopen zeven jaar" met een vlootbrede beschikbaarheid van ongeveer 99,999%. Water kan ongeveer 4.000 keer meer warmte per volume-eenheid transporteren dan lucht voor een gegeven temperatuurverandering – cruciaal nu individuele AI-acceleratorchips steeds meer 1.000 watt of meer dissiperen.

Duurzame Infrastructuur voor de Toekomst van AI

De uitdagingen op het gebied van stroomvoorziening en koeling zijn net zo cruciaal als de ontwikkeling van de chips zelf. Een efficiënte en betrouwbare infrastructuur is de ruggengraat van elke grootschalige AI-implementatie. Google's investeringen in geavanceerde koelsystemen en energiezuinige stroomdistributie zijn essentieel om de hoge prestaties van Ironwood TPU's te garanderen en tegelijkertijd de operationele kosten en milieu-impact te minimaliseren. Deze focus op duurzaamheid en schaalbaarheid op infrastructuurniveau is een fundamenteel onderdeel van Google's strategie, die verder reikt dan de headlines die verklaren: Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions. Het garanderen van een stabiele en efficiënte operationele omgeving is de sleutel tot het waarmaken van de belofte van AI op gigawatt-schaal.

De Uitdaging aan Nvidia's Dominantie en Google's Strategie

Google's aankondigingen komen op een moment dat de AI-infrastructuurmarkt een keerpunt bereikt. Terwijl Nvidia een overweldigende dominantie behoudt in AI-accelerators – met een geschat marktaandeel van 80-95% – investeren cloudproviders steeds meer in op maat gemaakte silicium om hun aanbod te differentiëren en de eenheidseconomie te verbeteren. Amazon Web Services (AWS) was pionier met zijn Graviton Arm-gebaseerde CPU's en Inferentia/Trainium AI-chips. Microsoft heeft Cobalt-processoren ontwikkeld en werkt naar verluidt aan AI-accelerators. Google biedt nu de meest uitgebreide portfolio van custom silicon onder de grote cloudproviders, een duidelijke indicatie dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions, niet alleen een productlancering is, maar een strategische uitdaging.

De strategie staat voor inherente uitdagingen. Ontwikkeling van op maat gemaakte chips vereist enorme investeringen vooraf – vaak miljarden dollars. Het software-ecosysteem voor gespecialiseerde accelerators loopt achter op Nvidia's CUDA-platform, dat profiteert van meer dan 15 jaar aan ontwikkelaarstools. En snelle evolutie van AI-modelarchitectuur creëert het risico dat op maat gemaakt silicium dat is geoptimaliseerd voor de modellen van vandaag, minder relevant wordt naarmate nieuwe technieken verschijnen. Toch beweert Google dat zijn aanpak unieke voordelen oplevert. "Dit is hoe we tien jaar geleden de eerste TPU bouwden, wat op zijn beurt acht jaar geleden de uitvinding van de Transformer mogelijk maakte – de architectuur die het grootste deel van moderne AI aandrijft," merkte het bedrijf op, verwijzend naar de baanbrekende "Attention Is All You Need"-paper van Google-onderzoekers in 2017.

De Lange Termijn Visie Achter Maatwerk Siliconen

Het argument is dat strakke integratie – "modelonderzoek, software en hardwareontwikkeling onder één dak" – optimalisaties mogelijk maakt die onmogelijk zijn met standaard componenten. Behalve Anthropic gaven verschillende andere klanten vroege feedback. Lightricks, dat creatieve AI-tools ontwikkelt, rapporteerde dat vroege Ironwood-tests "ons zeer enthousiast maken" over het creëren van "genuanceerdere, preciezere en hogere-fidelity beeld- en videogeneratie voor onze miljoenen wereldwijde klanten," aldus Yoav HaCohen, onderzoeksdirecteur van het bedrijf. Deze lofbetuigingen van partners versterken de boodschap dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions, echt een stempel drukt op de toekomst van AI. De investering in op maat gemaakte hardware en een geïntegreerd ecosysteem is een bewuste keuze om een voorsprong te behouden in de snel evoluerende AI-markt.

Conclusie

Google's recente aankondigingen, culminerend in de lancering van Ironwood TPU's en Axion-processors, vertegenwoordigen een cruciale stap in de evolutie van AI-infrastructuur. Met een vier keer zo grote prestatieverbetering en een ongekende verbintenis van Anthropic voor één miljoen chips, is het duidelijk dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions veel meer is dan alleen een technische prestatie. Het is een strategische beweging die de positie van Google Cloud in de competitieve AI-markt aanzienlijk verstevigt. De focus op inferentie, de verticale integratie van hardware en software, en de aanpak van de gigantische infrastructuuruitdagingen zoals stroom en koeling, tonen Google's langetermijnvisie en toewijding.

De aankondigingen van Google roepen vragen op die de komende kwartalen beantwoord zullen worden. Kan de industrie de huidige infrastructuuruitgaven handhaven, met grote AI-bedrijven die gezamenlijk honderden miljarden dollars toezeggen? Zullen op maat gemaakte silicium economisch superieur blijken te zijn aan Nvidia GPU's? Hoe zullen modelarchitecturen evolueren? Voor nu lijkt Google toegewijd aan een strategie die het bedrijf al decennia definieert: het bouwen van aangepaste infrastructuur om applicaties mogelijk te maken die onmogelijk zijn op commodity-hardware, en die infrastructuur vervolgens beschikbaar maken voor klanten die vergelijkbare capaciteiten willen zonder de kapitaalinvestering. Als de AI-industrie overgaat van onderzoekslabs naar productiedistributies die miljarden gebruikers bedienen, kan die infrastructuurlaag – het silicium, de software, het netwerk, de stroom en de koeling die het allemaal draaiende houden – even belangrijk blijken te zijn als de modellen zelf. En als de bereidheid van Anthropic om toegang te krijgen tot maar liefst één miljoen chips een indicatie is, dan werpt de gok van Google op op maat gemaakte silicium, speciaal ontworpen voor de 'age of inference', zijn vruchten af, precies op het moment dat de vraag een keerpunt bereikt. Met deze ambitieuze strategie bevestigt Google dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions, niet zomaar een nieuwsfeit is, maar een fundamentele verandering in het landschap van AI.

Veelgestelde Vragen over Google's Nieuwe AI-Chips

V1: Wat houdt de aankondiging in dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions?

A1: Deze aankondiging betekent dat Google Cloud zijn nieuwste generatie Tensor Processing Units (TPU's), genaamd Ironwood, heeft gelanceerd. Deze chips bieden een vier keer zo hoge prestatieverbetering voor AI-workloads. Daarnaast heeft Google een deal gesloten met AI-bedrijf Anthropic, waarbij Anthropic toegang krijgt tot maar liefst één miljoen van deze nieuwe TPU-chips, wat een transactie van tientallen miljarden dollars vertegenwoordigt en de schaal van Google's AI-ambities onderstreept.

V2: Hoe beïnvloedt de megadeal met Anthropic de positie van Google in de AI-markt?

A2: De megadeal met Anthropic, waarbij zij tot één miljoen Ironwood TPU-chips zullen gebruiken, is een enorme validatie van Google's custom silicon strategie. Het positioneert Google Cloud als een koploper in het leveren van essentiële infrastructuur voor de meest veeleisende AI-modellen, zoals Anthropic's Claude. Dit versterkt de concurrentiepositie van Google ten opzichte van andere cloudproviders en Nvidia, en laat zien dat Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions een serieuze uitdager is in de AI-hardwaremarkt.

V3: Welke bredere impact heeft de lancering van Ironwood en de Anthropic-deal op de AI-industrie, zoals blijkt uit "Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions"?

A3: De lancering van Ironwood en de deal met Anthropic markeren een verschuiving in de AI-industrie, van de nadruk op het trainen van modellen naar het efficiënt en schaalbaar inzetten van deze modellen (inferentie). Het toont ook de toenemende trend van cloudproviders om te investeren in op maat gemaakte chips om hun aanbod te differentiëren en de prestaties te optimaliseren. De aankondiging van Google debuts AI chips with 4X performance boost, secures Anthropic megadeal worth billions stimuleert verdere innovatie in zowel hardware als software binnen de AI-infrastructuur en intensiveert de concurrentie tussen de grote tech-spelers.

Mis Geen Enkele Ontwikkeling in de Digitale Wereld!

De wereld van technologie evolueert razendsnel, met AI op de voorgrond. Blijf verbonden en profiteer van de beste entertainmentopties met onze geavanceerde IPTV-abonnementen. Of je nu geïnteresseerd bent in de nieuwste AI-doorbraken, sportevenementen, films of series, met onze diensten heb je toegang tot een ongekend aanbod, overal en altijd. Ervaar de toekomst van entertainment met kristalheldere kwaliteit en ongeëvenaarde betrouwbaarheid.

Wacht niet langer en ontdek de perfecte IPTV-oplossing voor jou! IPTV kopen – jouw toegang tot de wereld van onbeperkt entertainment.